转自:新智元

最近,谷歌AI团队受Transformer和DETR的启发提出了一种使用Mask Transformer进行全景分割的端到端解决方案。

全称是end-to-end solution for panoptic segmentation with mask transformers,主要用于生成分割MaskTransformer架构的扩展。

该解决方案采用像素路径(由卷积神经网络或视觉Transformer组成)提取像素特征,内存路径(由Transformer解码器模块组成)提取内存特征,以及双路径Transformer用于像素特征和内存之间的交互特征。

然而,利用交叉注意力的双路径Transformer最初是为语言任务设计的,它的输入序列由几百个单词构成。

而对视觉任务尤其是分割问题来说,其输入序列由数万个像素组成,这不仅表明输入规模的幅度要大得多,而且与语言单词相比也代表了较低级别的嵌入。

全景分割是一个计算机视觉问题,它是现在许多应用程序的核心任务。

它分为语义分割和实例分割两部分。

语义分割就比如为图像中的每个像素分配语义标签,例如「人」和「天空」。

而实例分割仅识别和分割图中的可数对象,如「行人」和「汽车」,并进一步将其划分为几个子任务。

每个子任务单独处理,并应用额外的模块来合并每个子任务阶段的结果。

这个过程不仅复杂,而且在处理子任务和整合不同子任务结果时还会引入许多人工设计的先验。

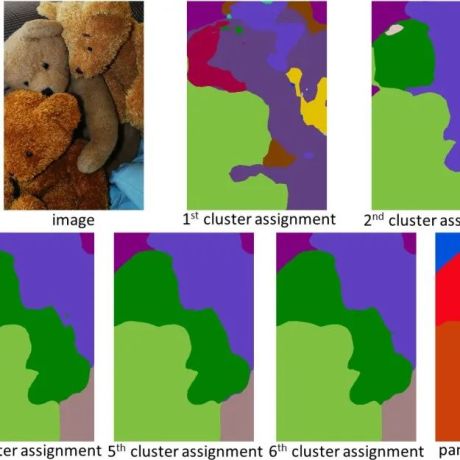

在 CVPR 2022 上发表的「CMT-DeepLab: Clustering Mask Transformers for Panoptic Segmentation」中,文章提出从聚类的角度重新解读并且重新设计交叉注意力cross attention(也就是将相同语义标签的像素分在同一组),从而更好地适应视觉任务。

CMT-DeepLab 建立在先前最先进的方法 MaX-DeepLab 之上,并采用像素聚类方法来执行交叉注意,从而产生更密集和合理的注意图。

kMaX-DeepLab 进一步重新设计了交叉注意力,使其更像一个 k-means 聚类算法,对激活函数进行了简单的更改。

结构总览

研究人员将从聚类的角度进行重新解释,而不是直接将交叉注意力应用于视觉任务而不进行修改。